Un experimento permite distinguir entre dos interpretaciones distintas del principio de incertidumbre de Heisenberg.

|

Una de los principios más misteriosos e interesantes de la Mecánica Cuántica es el principio de incertidumbre (o indeterminación) de Heisenberg. Nos dice que hay límites a lo que podemos conocer sobre los sistemas cuánticos.

Así por ejemplo, si nos fijamos en la versión que relaciona la cantidad de movimiento (o momento) de una partícula y su posición nos dice que cuanto mejor conozcamos la posición de una partícula peor conoceremos su cantidad de movimiento (el producto de su masa y velocidad o momento) y viceversa. Estas dos cantidades conjugadas (posición y momento) no son las únicas, así por ejemplo, el tiempo y la energía también tienen su propia relación de incertidumbre. Se pueden buscar otras cantidades conjugadas que sufran de lo mismo.

Se considera a Heisenberg el padre de la Mecánica Cuántica (MC). Cuando introdujo su famoso principio en 1927 imaginó en un experimento mental a un electrón que es observado con un microscopio basado en fotones de rayos gamma. De este modo cuando se quisiera medir la posición del mismo con un error ε(q) se podía alterar su momento en una cantidad η(p) que estarían regulados por la relación ε(q)η(p) ≥ h/4 π (siendo h la constante de Plank). Digamos que la medida altera el estado del sistema de tal modo que no podemos saber ciertas cantidades simultáneamente mejor de lo que nos dice esa relación. Esta relación tendría en cuanta el error en la medición.

Ese mismo año, Earle Kennard, propuso otra relación de incertidumbre muy similar en la forma, pero conceptualmente distinta. En esta formulación el principio de incertidumbre dice que σ(q)σ(p) ≥ h/4π. En este caso viene a decir que las fluctuaciones cuánticas de la posición y del momento no se pueden suprimir simultáneamente por debajo de cierto límite. Si reducimos las fluctuaciones en uno las aumentamos en el otro. Esto expresaría un concepto más estadístico y universal en el que se tendría en cuanta la dispersión (a través de la desviación típica).

Aunque desde entonces algunos han creído que ambas formulaciones son básicamente la misma y que ambas describen el mismo fenómeno, en realidad no es así. Como se puede observar, la ecuación es prácticamente la misma, pero conceptualmente son muy distintas. En el primer caso parece tratarse de una torpeza nuestra a la hora de medir y en la segunda a algo intrínseco al sistema. Los físicos usan la formulación de Kennard en la actualidad.

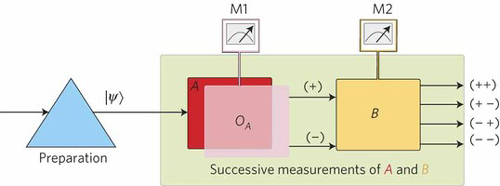

Este tipo de situaciones en las que hay varias interpretaciones son habituales en MC y no suelen solucionarse debido a que es muy difícil diseñar un experimento que las distinga. Pues bien, unos físicos de las universidades de Viena y Tokio dirigidos por Yuji Hasegawa han realizado un experimento con neutrones que permite distinguir entre estos dos casos. En lugar de medir la relación posición-momento han medido dos componentes ortogonales del estado de polarización del spin de los neutrones de un haz (algo equivalente bajo del principio de incertidumbre que mide otras dos cantidades conjugadas). La conclusión es que la interpretación de Heisenberg es incorrecta y que la correcta es la de Kennard, que es la que se viene usando en la Física moderna desde hace mucho tiempo.

En el experimento se preparó un haz de neutrones en el que se midió dos componentes spin simultáneamente en clara violación del principio de incertidumbre según la interpretación original. La otra interpretación se mantuvo. El resultado, de haber sido el contrario, hubiera sacudido los cimientos de la Mecánica Cuántica moderna.

Este resultado se ha conseguido gracias a que en 2003 Masanao Ozawa (Universidad de Nagoya) llegó a una expresión del principio que permitía describir tanto el error como las fluctuaciones: ε(q) η(p) + σ(q)η(p) + σ(p)ε(q) ≥ h/4π.

En el experimento se pudo precisamente distinguir entre errores en la medida y fluctuaciones. Algo sorprendente cuando muchos físicos habían pensado que la única manera de reducir los errores es suprimiendo las fluctuaciones. Pero la desigualdad de Ozawa sugiere que hay otra manera de reducir errores al permitir al sistema tener grandes fluctuaciones, aunque suene contradictorio.

Pero en el mundo real el error en la medida siempre está ahí, sumándose a las fluctuaciones, así que desde el punto de vista experimental y práctico la formulación de Ozawa resulta útil al tener en cuenta tanto fluctuaciones como errores en la medida y su alteración provocada por el acto de medida.

Cuando se divulga la MC se suele expresar la idea ingenua de que la relación de incertidumbre surge porque la medida experimental de una cantidad X da al traste con la medida de la cantidad complementaria Y. Este experimento ayudar a eliminar esa idea.

No es que seamos torpes a la hora de medir cantidades conjugadas, es que por muy bien que lo hagamos es imposible medirlas con precisión debido a sus fluctuaciones inherentes. Sí, la MC es tan rara como siempre se ha creído, incluso más de lo que cree la gente común.

Copyleft: atribuir con enlace a http://neofronteras.com/?p=3765 [1]

Fuentes y referencias:

Noticia en Physicsworld. [2]

Noticia en Scientific American. [3]

Artículo original. [4]